AlexNet | Abstract 第4文

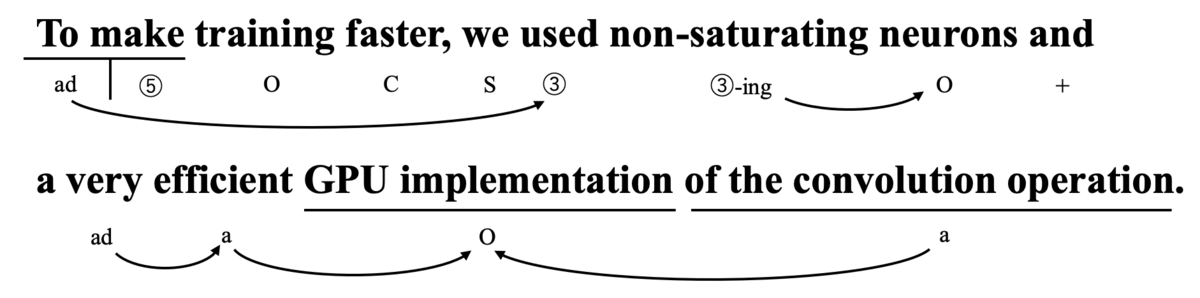

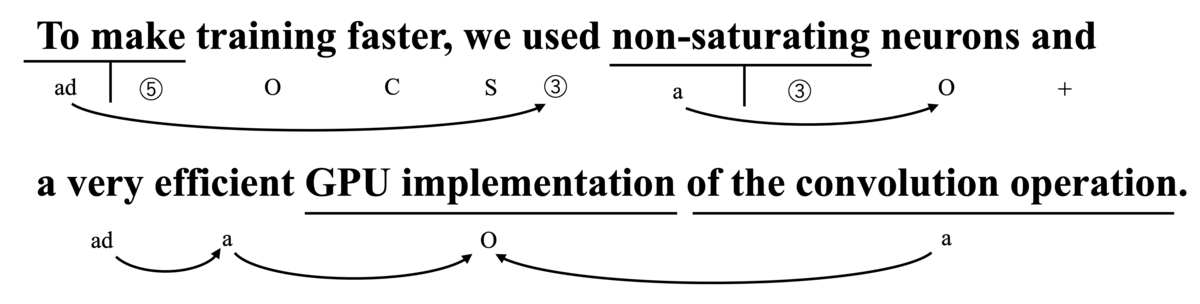

To make training faster, we used non-saturating neurons and a very efficient GPU implementation of the convolution operation.

Alex Krizhevsky, et al., "ImageNet Classification with Deep Convolutional Neural Networks"

2012年のILSVRCで1位になったディープラーニングモデルであるAlexNetの論文の"ImageNet Classification with Deep Convolutional Neural Networks"のAbstractの第4文について、英語リーディング教本のFrame of Reference(F.o.R.)を使って英文構造を解読します。

「訓練をより早くするため、我々は飽和させないニューロンと畳み込み操作を非常に効率的に行うGPUの実装を用いた。」

"non-saturating"は見慣れない単語なので、解説します。

saturateは飽和させるという意味の③の動詞です。それにnon-がついていて、non-saturateは飽和させないという意味のものです。saturateには自動詞の意味はありませんのでnon-saturateは①ではありません。したがって、non-saturatingは③のing形ですから、目的語が必要です。ところが、このnon-saturatingには目的語がついていません(neuronはnon-saturatingの目的語ではなく、non-saturatingによって修飾される被修飾語です)。つまり、このnon-saturatingは③-ingが目的語を伴わずに形容詞の働きをして、名詞を修飾しています。

補足のため、③-ingを省略しないで書くと次のようになります。neuronsにかかるのはnon-saturatingの前の形容詞の働きであって、neuronsはnon-saturatingの後ろの動詞③の働きの目的語ではありません。

このような場合には、読者が前後の文脈からnon-saturatingの意味上の目的語(O')を推測して、「意味上の目的語を飽和させないような性質を持っている」という意味に読む必要があります。

では、"non-saturating neuron"、「飽和させないような性質を持っているニューロン」によって、「何が」飽和されないのでしょうか。

結論から言うと、ニューロンへの入力xに対する出力f(x)が飽和されないと言う意味だと解釈できるかと思います。

これに関しては論文の本文の3.1節を読むと見えてきます。

The standard way to model a neuron’s output f as a function of its input x is with f(x) = tanh(x) or f(x) = (1 + e−x)−1. In terms of training time with gradient descent, these saturating nonlinearities are much slower than the non-saturating nonlinearity f(x) = max(0,x).

Christian Szegedy, et al., "ImageNet Classification with Deep Convolutional Neural Networks"

飽和させる(saturating)のは、tanhやsigmoid関数だと記述があります。

一方、飽和させない(non-saturating)のは、ReLUのことです。

つまり、入力xに対して出力f(x)が飽和するかしないか、という観点になります。

tanh(x)やsigmoid(x)はどんなに大きな入力xを与えても、出力f(x)の最大値は1なので、このことを飽和と表現していると考えられます。

一方で、ReLU(x)は、大きなxを与えれば出力f(x)はそれだけ大きくなりますので飽和しないということになります。

したがって、"non-saturating neuron"というのは「入力xに対して出力f(x)を飽和させないような性質を持っているニューロン(つまりReLU)」という意味と捉えることができます。

なお、「英語構文のエッセンスStage-2」に「目的語が足りない現在分詞形容詞用法」として説明がありますので、F.o.R.の基本から外れた内容とも言えます。しかし、上述の説明は「英語リーディング教本」にも記載がありますので、F.o.R.の基本の範囲内としました。そのため、このブログ記事には<F.o.R.の基本に従わない英文>のタグはつけていません。

AlexNetの概要については、画像認識 (機械学習プロフェッショナルシリーズ)のChapter 6 (畳み込みニューラルネットワーク)に説明があります。

薬袋善郎先生の公式ウェブサイト